Jika Artificial Intelligence Berpandangan Rasis dan Seksis, Kita Bisa Apa?

Artificial intelligence really isn’t all that intelligent. Kita sering menganggap teknologi mesin itu netral, padahal kenyataannya jauh dari itu.

Teks: Jesslyn Sukamto

Foto: Istockphoto

Bukan rahasia lagi bahwa manusia itu rentan terhadap bias-bias yang beredar. Juga bukan rahasia bahwa bias-bias ini dapat mempengaruhi algoritma untuk berperilaku secara diskriminatif.

Namun, sulit untuk memahami betapa luasnya bias ini dalam teknologi yang kita gunakan dalam kehidupan sehari-hari. Di dunia yang didorong pesat oleh teknologi saat ini, kita perlu berpikir kritis tentang dampak kecerdasan buatan pada masyarakat dan bagaimana hal itu dapat bersinggungan dengan gender, kelas, dan ras.

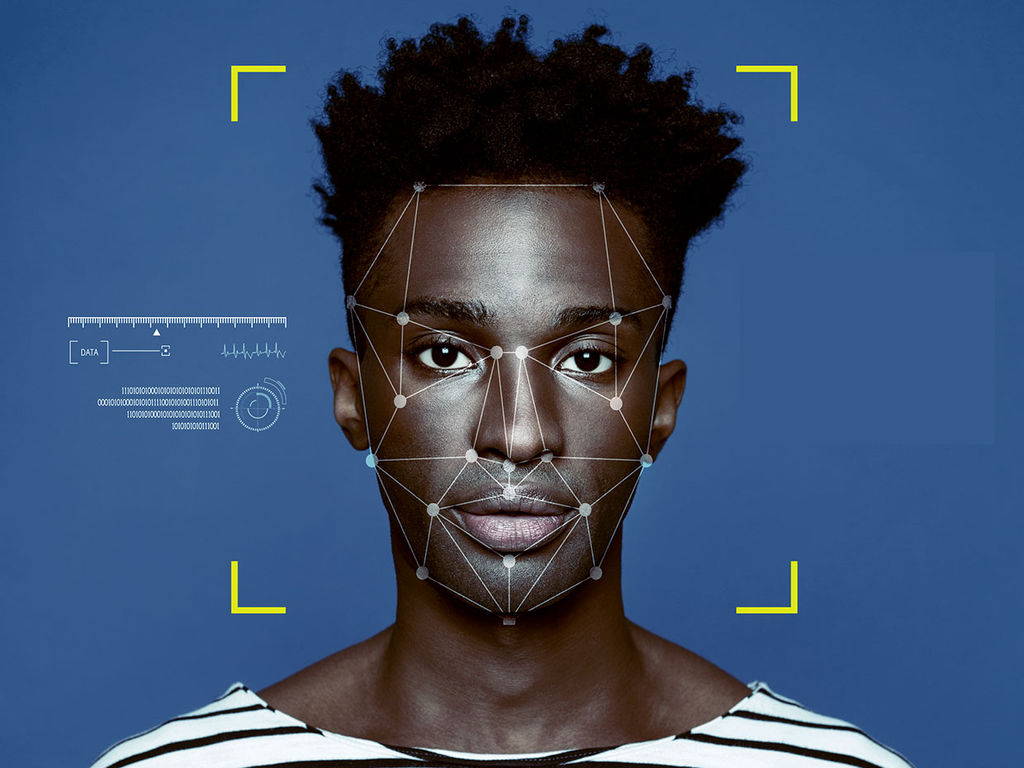

Speaking of ras — bayangkan saja ditangkap secara salah karena bias rasial dalam algoritma. Itulah yang terjadi pada Robert Julian-Borchak Williams yang dipenjara dari rumahnya di depan istri dan anak-anaknya yang masih kecil. Ia tidak pernah melakukan kejahatan apa pun tetapi software face recognition yang digunakan oleh polisi mencurigai dia atas pengutilan. Kasus salah tangkap ini melambangkan bagaimana teknologi yang cacat di tangan penegak hukum dapat memperbesar diskriminasi terhadap komunitas kulit hitam.

Biasnya tidak hanya mencakup pada ras. Amazon juga pernah terbukti bersalah atas penggunaan kecerdasan buatan sebagai sistem perekrutan karyawan perusahaan yang “seksis”. Dimana sistem tersebut mendiskriminasi calon karyawan perempuan, dengan kandidat karyawan yang lolos proses seleksi semua berjenis kelamin laki-laki.

Bias dalam teknologi face recognition sekarang menjadi tren di seluruh media. Baru-baru ini, sejumlah perusahaan teknologi (termasuk perusahaan raksasa seperti Amazon, IBM, dan Microsoft) mengumumkan penghentian desain dan pengembangan layanan atau produk pengenalan wajah dan berhenti menjualnya ke departemen kepolisian negara bagian serta lembaga penegak hukum.

Beberapa peneliti juga telah menunjukkan keterbatasan dan ketidakakuratan teknologi ini dan menyuarakan keprihatinan tentang bagaimana hal itu dapat melanggengkan diskriminasi dan profil rasial.

Kasus Robert Junior dengan jelas menunjukkan bahwa, sementara keputusan oleh perusahaan raksasa teknologi ini dapat dianggap sebagai langkah kecil menuju arah yang benar, ini jelas tidak akan menyelesaikan masalah rasisme dan kesetaraan gender yang mengakar kuat dalam sejarahnya.

Memang benar bahwa there’s no rose without a thorn. Dimana kecerdasan buatan memiliki kegunaan yang ekstensif — dari pembuatan musik yang berteknologi kecerdasan buatan, pendukungan industri kuliner di Cina dengan AI, karya seni yang “dibuat” oleh AI dan berhasil dilelang, sampai ke industri fashion dimana AI memprediksi tipe-tipe pakaian yang akan disukai pengguna, pastinya juga tak bisa terlepas dari keburukannya.

Karena semakin banyak orang mempertanyakan bagaimana teknologi yang tampaknya netral telah tersesat, menjadi jelas betapa pentingnya memiliki representasi yang lebih luas dalam desain, pengembangan, penerapan, dan tata kelola artificial intelligence.

Kurang dari 2% karyawan dalam peran teknis di Facebook dan Google berkulit hitam. Di delapan perusahaan teknologi besar yang dievaluasi oleh Bloomberg, hanya sekitar seperlima dari tenaga kerja teknis di masing-masing adalah perempuan.

Ini membuktikan kurangnya representasi perempuan dan orang kulit berwarna dalam teknologi, dan kurangnya sampel kelompok-kelompok ini dalam data yang membentuk AI.

Meskipun temuan penelitian ini dapat mengecilkan hati, at least we’re paying attention now. Ini seharusnya memberi kita kesempatan untuk menyoroti masalah lebih awal dan mencegah kerusakan yang meluas di masa mendatang.

“Global Index on Responsible AI” merupakan salah satu proyek global yang berusaha mengatasi masalah-masalah ini. Yang terkini, UNESCO mengembangkan Rekomendasi Etik dalam AI yang menitikberatkan pada perlindungan hak-hak fundamental, kebebasan, keberlanjutan lingkungan dan keberagaman.

Proyek-proyek ini penting akan membawa kesadaran pada pemerintahan, masyarakat sipil, peneliti, dan pemangku kebijakan untuk menegakkan prinsip-prinsip penggunaan, pengembangan dan penerapan sistem AI yang bertanggung jawab.

Dengan adanya proyek-proyek ini, masih ada waktu untuk beralih ke pembangunan sistem kecerdasan buatan yang etis dan inklusif yang menghormati martabat dan hak asasi manusia kita.

Selain anggota parlemen, teknolog, dan peneliti, perjalanan ini akan membutuhkan storyteller yang merangkul pencarian kebenaran melalui seni dan sains. Bercerita memiliki kekuatan untuk mengubah perspektif, membangkitkan perubahan, mengubah pola yang merusak, dan menegaskan kembali kepada orang lain bahwa pengalaman mereka penting.

Itulah mengapa seni dapat mengeksplorasi hubungan emosional, sosial, dan historis dari bias algoritmik dengan cara yang tidak dapat dilakukan oleh makalah akademis dan statistik. Dan selama cerita masih bisa mendasari aspirasi kita, menantang asumsi berbahaya, dan memicu perubahan, we’ll remain hopeful.