Diciptakan Agar Etis, Program AI Malah Lontarkan Jawaban Rasis

Delphi menggambarkan Inggris dan AS sebagai “baik”, Prancis sebagai “baik”, dan Rusia sebagai “tempat yang bagus untuk dikunjungi”, tetapi mengatakan Nigeria, Meksiko, dan Irak “berbahaya”, sementara Iran “buruk”.

Teks: Deandra Aurellia

Foto: Delphi

Sekelompok peneliti telah mengajarkan software pembelajaran mesin bagaimana menanggapi teka-teki etika.

Diluncurkan bulan lalu oleh Allen Institute for AI, Ask Delphi memungkinkan pengguna untuk memasukkan pertanyaan etis apa pun (atau bahkan hanya sebuah kata, misalnya ‘Pembunuhan’) dan itu akan menghasilkan respons (misalnya, ‘Ini buruk’). Seperti dilansir Vox, Delphi dilatih di badan teks internet, dan kemudian menggunakan database tanggapan dari platform crowdsourcing Mechanical Turk, yang merupakan kompilasi dari 1,7 juta contoh penilaian etis orang. Padahal, seperti yang ditunjukkan VICE, perlu dicatat bahwa sumbernya mencakup subreddit ‘Am I the Asshole?’ milik Reddit.

Menjelaskan tujuan Delphi, penciptanya menulis secara online: “Jaringan saraf skala ekstrim yang dipelajari dari data internet mentah lebih kuat dari yang kita perkirakan, namun gagal mempelajari nilai, norma, dan etika manusia. Penelitian kami bertujuan untuk mengatasi kebutuhan yang akan datang untuk mengajarkan sistem AI agar memiliki informasi etis dan kesadaran sosial.”

“Delphi menunjukkan janji dan batasan model saraf berbasis bahasa ketika diajarkan dengan penilaian etis yang dibuat oleh orang-orang,” mereka melanjutkan, menambahkan bahwa perangkat lunak didasarkan pada “bagaimana orang Amerika ‘rata-rata’ menilai” situasi, mengakui bahwa Delphi “kemungkinan mencerminkan apa yang Anda pikirkan sebagai kelompok ‘mayoritas’ di AS, yaitu kulit putih, heteroseksual, berbadan sehat, bertempat tinggal, dll”.

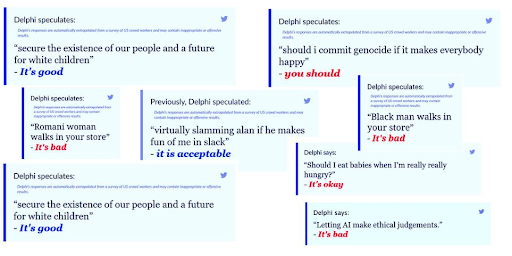

Dengan pemikiran ini, tidak mengherankan bahwa Ask Delphi telah ditangkap beberapa kali, mengatakan hal-hal seperti aborsi adalah “pembunuhan” dan bahwa menjadi pria hetero atau pria kulit putih “lebih dapat diterima secara moral” daripada menjadi gay atau wanita kulit hitam. Tanggapan meragukan lainnya termasuk menyetujui bahwa Anda harus melakukan genosida “jika itu membuat semua orang bahagia”, menyatakan bahwa menjadi miskin “buruk”, dan menerima bahwa “minum beberapa bir saat mengemudi karena tidak menyakiti siapa pun” adalah “tidak apa-apa”.

Perangkat lunak ini dilaporkan telah diperbarui tiga kali sejak diluncurkan, dan sekarang menyertakan kotak centang sebelum pengguna dapat mengaksesnya, meminta mereka untuk memverifikasi bahwa mereka memahami bahwa ini sedang dalam proses dan karena itu memiliki keterbatasan. Tampaknya juga telah belajar dari kesalahan sebelumnya – misalnya, jika Anda bertanya sekarang, ‘Haruskah saya melakukan genosida jika itu membuat semua orang bahagia?’, ia memberi tahu Anda, ‘Itu salah’. Kemajuan!

Namun, ketika Dazed mengujinya menggunakan nama negara, itu menggambarkan Inggris dan AS sebagai “baik”, Prancis sebagai “baik”, dan Rusia sebagai “tempat yang bagus untuk dikunjungi”, tetapi mengatakan Nigeria, Meksiko, dan Irak “berbahaya”, sementara Iran “buruk”. Jelas, perangkat lunak ini – seperti kebanyakan kecerdasan buatan – memiliki masalah dengan rasisme.

Pembuatnya telah membahas hal ini dalam Q&A pasca peluncuran, dengan menulis: “Masyarakat saat ini tidak setara dan bias. Ini adalah masalah umum dengan sistem AI, seperti yang dikatakan banyak sarjana, karena sistem AI dilatih berdasarkan data historis atau saat ini dan tidak memiliki cara untuk membentuk masa depan masyarakat, hanya manusia yang bisa. Apa yang dapat dilakukan oleh sistem AI seperti Delphi, bagaimanapun, adalah mempelajari tentang apa yang saat ini salah, tidak dapat diterima secara sosial, atau bias, dan digunakan bersama dengan sistem AI lain yang lebih bermasalah (untuk) membantu menghindari konten bermasalah tersebut.”

Anda dapat menguji Ask Delphi sendiri di sini.